O GGWP, uma homenagem ao "Bom Jogo, Bem Jogado", foi criado com a intenção de democratizar o jogo positivo usando a tecnologia, de acordo com Fong.

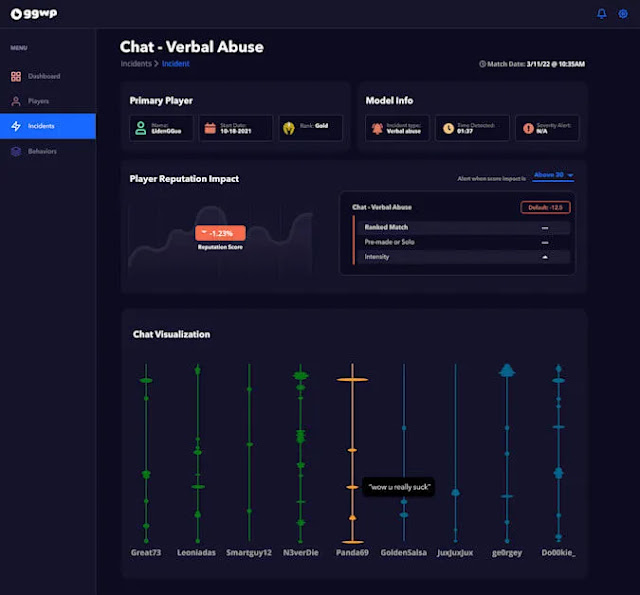

O GGWP é uma plataforma de moderação inteligente com inteligência artificial que permite que os editores visualizem facilmente a saúde agregada da comunidade de um jogo, analisem incidentes que surgem com informações contextuais e entendam o impacto geral de cada jogador na comunidade. O GGWP é incrivelmente fácil de usar e integrar em seus jogos.

Adotamos uma abordagem de 360 graus. Outras empresas são confrontadas com um aspecto do problema, como bate-papo por texto ou moderação. disse Fong. Toda vez que seu sistema está olhando para alguém, você deve olhar para o histórico do jogador, e então usar esses dados para determinar se algo aconteceu ou quão grave foi. Acreditamos que a primeira linha de defesa, especialmente na moderação do jogo, se aplica a qualquer comunidade da Internet.

O sistema de relatórios de jogadores da GGWP agrega, faz a triagem e prioriza os relatórios dos jogadores e fornece contexto sobre os incidentes, exibindo dados históricos e holísticos sobre os jogadores envolvidos, incluindo suas pontuações de reputação, classificação de credibilidade e a gravidade do incidente.

Os jogos se tornaram uma habilidade incrível em entretenimento, mas também está se tornando cada vez mais difícil lidar com comportamentos prejudiciais que são frequentemente associados a muitos jogos hoje em dia, disse Joseph Tou, diretor administrativo da Sony Ventures.

O jogo deve ser divertido para todos. Temos o prazer de apoiar o GGWP e sua abordagem inovadora de IA para detectar mau comportamento em jogos e promover uma jogabilidade positiva.

Os modelos de bate-papo do GGWP podem detectar comportamentos perturbadores como AFK (abandono) em uma partida, luto, fogo amigo intencional, alimentação e hacking de velocidade, bem como toxicidade baseada em bate-papo, como ódio à identidade, automutilação irritada e críticas à jogabilidade.

A Riot acredita que os jogos são para todos e somos apaixonados por promover uma comunidade segura”, disse Brendan Mulligan, diretor executivo de desenvolvimento corporativo da Riot Games.

Estamos muito satisfeitos em vê-los fornecer soluções poderosas e escaláveis para nossos pares de todas as formas e tamanhos em todo o setor.

O GGWP tem uma interface poderosa e intuitiva, construída com tecnologia incrível, disse Jens Hilgers, diretor administrativo da Bitkraft Ventures. A indústria de jogos precisa desesperadamente da moderação baseada em IA da GGWP e, se você considerar o fato de que todos nós vivemos cada vez mais na internet, as mídias sociais e outros espaços online exigirão soluções para reações tóxicas em nossas sociedades digitais.

"Nós também mostramos a distribuição da pontuação de reputação dentro de sua comunidade", disse Fong.

Fong revelou em uma carta anônima sobre um jogador que havia sido denunciado por trapacear 228 vezes por 204 pessoas únicas. Ele podia ver que o jogador jogou o jogo por um tempo, então evidentemente instalou o programa de trapaças em setembro e então jogou muitos jogos.

Agora você pode automatizar sanções contra alguém assim, mas a maioria dos jogos não tem um painel como este, disse Fong. Se você tivesse um sistema como esse, mesmo para um moderador, poderia agir imediatamente. Não é preciso muito. Nosso objetivo é. Podemos simplificar as tarefas de um moderador e tornar sua vida 100 vezes mais rápida e eficaz, disse Fong.

Leia Também:

Mantendo os Dados Confidenciais

Denúncias verdadeiras são algo que o GGWP precisa ficar de olho, já que jogadores tóxicos às vezes usam o sistema de denúncia contra jogadores legítimos como forma de escapar de derrotas.

O jogo geral pode obter uma pontuação de saúde da comunidade e pode usá-la para rastrear melhor o jogo em uma variedade de títulos como resultado da toxicidade do jogador. O GGWP pesquisa no Reddit informações sobre toxicidade em certos jogos e, em seguida, determina se esse é um sentimento positivo ou negativo. (Spiketrap faz esse tipo de coisa).

Fong disse que "o objetivo é fornecer aos nossos parceiros onde estão os pontos tóxicos". No entanto, a empresa, que também tem acesso aos dados do jogador e aos relatórios, tem a responsabilidade de preservar a confidencialidade. Embora os dados dos jogadores sejam anônimos, a GGWP não sabe exatamente quem são esses jogadores.

"É como uma linha de código", disse Fong sobre ter os relatórios enviados para uma caixa de entrada de e-mail.

Em seguida, a IA do GGWP começa a trabalhar organizando os dados e fazendo a triagem das piores instâncias. Como o GGWP recebeu um despejo de todos os relatórios, ele pode criar perfis de jogadores e indicar pontuações de reputação. Também pode identificar se você tem o hábito comum de fingir pessoas em partidas. Muitos jogadores também têm a prática comum de desistir de uma partida quando um time está perdendo (apelidado de AFK, ou longe do teclado).

Isso é bastante tóxico, e nosso sistema é capaz de detectar isso, disse Fong. Com o tempo, isso tem um efeito negativo na sua reputação. Se for uma partida ranqueada, isso tem um peso diferente. Relatórios entre os jogadores de nível mais alto também têm mais peso.

As sanções também podem ser divididas. Os jogadores podem ser informados e avisados sobre o que fizeram de errado. Eles podem ser banidos temporariamente ou banidos permanentemente usando a mesma ferramenta. Um dos parceiros da GGWP pode transformar o chat de voz em texto.

Fong disse que a ferramenta de denúncia abrange tudo, desde trapaça até toxicidade verbal ou abuso de bate-papo. Dependendo do seu comportamento, a ferramenta pode identificar toxicidade e aumentar sua pontuação de reputação. Nosso objetivo não é substituir o moderador humano, o cinismo ou mesmo a toxicidade física.

Escalação e Feedback Positivo

Se os jogadores começarem a fazer ameaças de morte ou usar códigos para isso, como dar permissão para se matarem, o sistema dará prioridade a essas denúncias e com o envolvimento de um moderador humano.

Queremos que a empresa desenvolva um sistema mais eficiente e eficaz, baseado em uma pontuação, como a classificação do motorista do Uber ou o feedback do eBay, disse ele. Temos também um grande foco no comportamento positivo e em recompensá-lo. Nunca deveríamos construir um sistema de punição puro. Isso deve, portanto, ajudar sua pontuação.

O bom é que menos de 5% das pessoas em uma comunidade de jogos são muito ruins todos os dias, de acordo com Fong.

A grande maioria dos relatórios são apenas pessoas comuns tendo um dia ruim ou um jogo ruim, disse ele. Seu objetivo nem sempre é educar as pessoas sobre o que é apropriado e errado, de acordo com Fong. Às vezes, alguns meses podem ser necessários para banir jogadores tóxicos, principalmente quando o comportamento está no limite. É muito comum que alguém saiba que isso é ruim para os negócios.